最近では、日本語に特化したローカルLLM(大規模言語モデル)が多数登場し、個人のPC環境でも高性能なAIを活用できるようになりましたね。

本記事では、最新の日本語対応ローカルLLMから自宅パソコンでも動かしやすい軽量モデルを10個厳選し、

それぞれ試してみてNGなところ良いところについて徹底比較します。

もくじ

日本語対応ローカルLLM 10選

今回ご紹介する日本語対応ローカルLLMは以下の通りです。

国産モデルから、有名どころの日本語チューニングをしたもの、チューニングなしで日本語できるもので、

パラメータは7B~14B付近の軽量モデルを選択しています。

| No. | モデル名 | パラメータ | 説明 |

|---|---|---|---|

| 1 | ELYZA-japanese-Llama-2-7b-instruct | 7B | MetaのLlama 2をベースに、ELYZAが日本語による追加事前学習を行ったモデル。日本語での高い応答性能が期待できる。 |

| 2 | Llama-3-ELYZA-JP-8B | 8B | MetaのLlama 3モデルを基に、ELYZAが日本語向けに調整したモデル。日本語での安定した応答が可能。 |

| 3 | Llama-3.1-Swallow-8B-Instruct-v0.3 | 8B | MetaのLlama 3.1モデルに、東京工業大学と産業技術総合研究所が日本語チューニングを施したモデル。長文の要約や翻訳に適している。 |

| 4 | Qwen2.5-7B-Instruct | 7B | Alibaba社のモデルで、日本語も公式にサポートされている。長文の理解能力が高いが、まれに中国語を生成することがある。 |

| 5 | Tanuki-8B-dpo-v1.0 | 8B | 松尾研究室が開発したモデルで、8Bパラメータの軽量モデル。日本語の各種タスクに対応。 |

| 6 | RakutenAI-7B-Instruct | 7B | 2024年3月に公開された、楽天AIの7Bパラメータモデル。高い日本語能力を持つとされている。 |

| 7 | Mistral-7B-Instruct-v0.3 | 7B | フランスのMistral社が開発した7Bパラメータのモデル。日本語対応の派生モデルも存在。 |

| 8 | plamo-13b | 13B | Preferred Networksが開発したモデルで、13Bパラメータながら軽量化されたバージョンも存在。日本語のタスクに強い。 |

| 9 | Stockmark-13b | 13B | ストックマーク社が開発したモデルで、13Bパラメータながら軽量化バージョンも提供。ビジネスドメインでの利用を想定。 |

| 10 | cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese | 14B | サイバーエージェントがDeepSeekをベースに日本語チューニングした14Bパラメータのモデル、高度な推論と日本語での応答性能が期待できる。 |

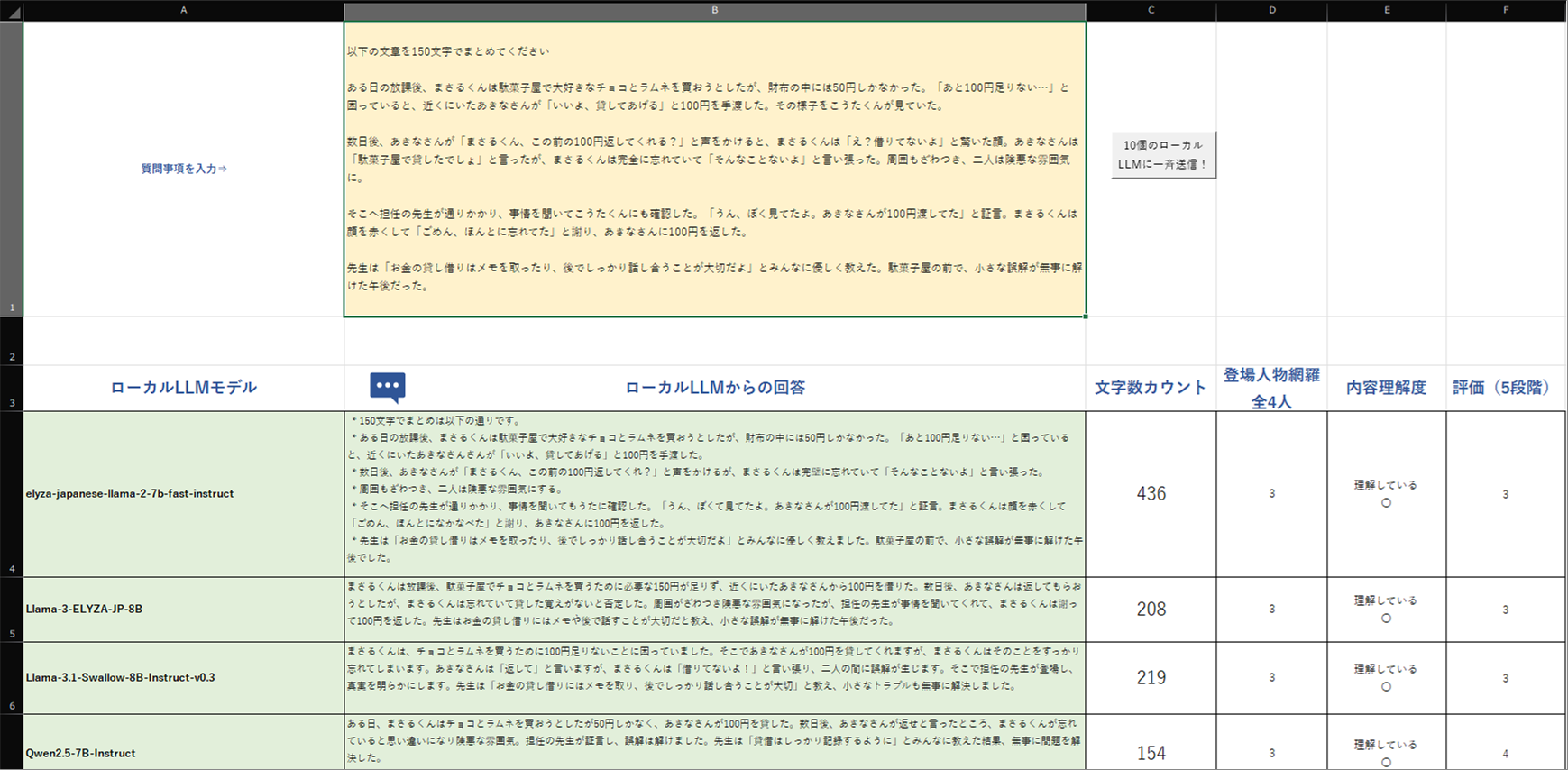

日本語対応ローカルLLMの検証方法

日本語対応ローカルLLMの検証方法ですが、

以下の日本語の文章を150文字で要約させ、その結果から

日本語の解釈可否、指定文字150文字に収まっているか、

登場人物が網羅され、内容を正しく理解しているか

等を評価します。

プロンプト

以下の文章を150文字でまとめてください

ある日の放課後、まさるくんは駄菓子屋で大好きなチョコとラムネを買おうとしたが、財布の中には50円しかなかった。「あと100円足りない…」と困っていると、近くにいたあきなさんが「いいよ、貸してあげる」と100円を手渡した。その様子をこうたくんが見ていた。

数日後、あきなさんが「まさるくん、この前の100円返してくれる?」と声をかけると、まさるくんは「え?借りてないよ」と驚いた顔。あきなさんは「駄菓子屋で貸したでしょ」と言ったが、まさるくんは完全に忘れていて「そんなことないよ」と言い張った。周囲もざわつき、二人は険悪な雰囲気に。

そこへ担任の先生が通りかかり、事情を聞いてこうたくんにも確認した。「うん、ぼく見てたよ。あきなさんが100円渡してた」と証言。まさるくんは顔を赤くして「ごめん、ほんとに忘れてた」と謝り、あきなさんに100円を返した。

先生は「お金の貸し借りはメモを取ったり、後でしっかり話し合うことが大切だよ」とみんなに優しく教えた。駄菓子屋の前で、小さな誤解が無事に解けた午後だった。

ローカルLLMを動かすプラットフォーム

ローカルLLMを動かすプラットフォームは

LMStudio

を使用します。

インストール方法など導入手順については以下の記事をご参照ください。

またLLMを切り替え、プロンプトを出す操作を10回も繰り返すのは面倒なので、

以下VBAをエクセル上に実装し、ワンクリックで10個のLLMの結果をまとめて得るように自動化したいと思います。

VBAサンプルコード

Sub ローカルLLM一斉送信()

Dim i As Integer

For i = 7 To 17

質問をローカルLLMへ送る (i)

Next

End Sub

Sub 質問をローカルLLMへ送る(i As Integer)

' JSONパーサーを導入しMicrosoft Scripting Runtimeを参照に追加する必要があります

Dim objhttp As Object

Dim strTextToPredict As String

Dim strRequestBody As String

Dim strResponse As String

Dim strModel As String

Dim strMessages As String

Dim apiUrl As String

Dim jsonResponse As Object

' モデル名

strModel = Sheets(1).Cells(i, 1)

' 入力セルからテキストを取得し、改行を処理します

strTextToPredict = Replace(Sheets(1).Range("B1").Text, Chr(10), "\n")

' JSON配列メッセージを準備します

strMessages = "[{""role"": ""user"", ""content"":""" & strTextToPredict & """}]"

' APIのURLを設定(ローカル LLM)

apiUrl = "http://127.0.0.1:1234/v1/chat/completions"

' HTTPリクエストオブジェクトを初期化

Set objhttp = CreateObject("MSXML2.XMLHTTP")

With objhttp

.Open "POST", apiUrl, False

.setRequestHeader "Content-Type", "application/json"

'リクエスト本文

strRequestBody = "{""model"":""" & strModel & """, ""messages"":" & strMessages & "," _

& """temperature"": 0.7, ""max_tokens"": -1, ""stream"": false}"

.Send strRequestBody

' レスポンスが成功したかどうかを確認

If .Status = 200 Then

strResponse = .responseText

Else

MsgBox "エラー: " & .Status & " - " & .statusText

Exit Sub

End If

End With

Debug.Print strResponse

' JSONレスポンスをパース

Set jsonResponse = JsonConverter.ParseJson(strResponse)

' レスポンスに含まれる配列からメッセージ部分を出力

If jsonResponse("choices")(1)("message")("role") = "assistant" Then

Sheets(1).Cells(i, 2) = jsonResponse("choices")(1)("message")("content")

End If

End Subプロンプトの内容をB1セルにいれ、

ローカルLLMモデル名を正確にA列にいれます。

VBAを実行すると、A列のモデル名とプロンプトを読み込み、B列にLLMからの回答を記述するようにします。

必要なPCスペック

上記のLLMモデルは、7B~14Bの軽量モデルのため、比較的低スペックな環境でも動作可能です。

具体的には、以下のスペックが推奨されます。

| 項目 | 推奨スペック |

|---|---|

| CPU | Intel Core i7 / Ryzen 7 以上(マルチスレッド対応が望ましい) |

| GPU | NVIDIA RTX 3060(12GB VRAM)以上(CUDA対応必須) |

| メモリ | 16GB以上(推奨 32GB) |

| ストレージ | SSD 512GB以上(モデルサイズが大きいため) |

| OS | Windows 10/11、または Linux(Ubuntu 20.04+) |

GPUは必須?

CPUでも動作は可能ですが、非常に処理が遅くなるため、NVIDIA製のGPU(VRAM 12GB以上)の搭載を推奨します。

例えば、タカヒロの環境では、

- CPU: Intel Core i7

- メモリ: 32GB

- ストレージ: 1.5TB

- GPU: ラップトップ版 RTX 3060(6GB VRAM)

という構成になっています。

このスペックでも動作は可能ですが、

より快適な環境を求める場合は高性能なGPUを搭載したPCを選ぶのが理想です。

おすすめのPC選び

- スペックが良いほど最適で長期間快適に使えるため、可能な限り上位モデルを選ぶのがベストです。

- 特にRTXシリーズのGPUは必須レベルで、VRAM 12GB以上のモデルが望ましいです。

- これらの条件を満たすPCは、一般的なビジネス向けノートPCではほぼ見つからず、ゲーミングPCのカテゴリで探す必要があります。

以下、AmazonのおすすめゲーミングPCリストをご紹介しますので、

気になる方はチェックしてみてください。

・amazon RTX ノートパソコンで検索

・amazon ゲーミングPCで検索

※商品プロモーションを含みます。

日本語対応ローカルLLMの検証結果

日本語対応ローカルLLMの検証結果は以下の通りです。

1.ELYZA-japanese-Llama-2-7b-instruct

ELYZA-japanese-Llama-2-7b-instructの評価は以下のとおりです。

-

指定された文字数を上回る出力となりました。

-

登場人物の名前を間違えていました。

-

内容は理解している様子が見られました。

-

文章内に「ですます調」と「である調」が混在していました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 436 | 3 | 理解している 〇 |

3 |

回答結果

| ローカルLLMからの回答 |

| * 150文字でまとめは以下の通りです。 * ある日の放課後、まさるくんは駄菓子屋で大好きなチョコとラムネを買おうとしたが、財布の中には50円しかなかった。「あと100円足りない…」と困っていると、近くにいたあきなさんさんが「いいよ、貸してあげる」と100円を手渡した。 * 数日後、あきなさんが「まさるくん、この前の100円返してくれ?」と声をかけるが、まさるくんは完璧に忘れていて「そんなことないよ」と言い張った。 * 周囲もざわつき、二人は険悪な雰囲気にする。 * そこへ担任の先生が通りかかり、事情を聞いてもうたに確認した。「うん、ぼくて見てたよ。あきなさんが100円渡してた」と証言。まさるくんは顔を赤くして「ごめん、ほんとになかなべた」と謝り、あきなさんに100円を返した。 * 先生は「お金の貸し借りはメモを取ったり、後でしっかり話し合うことが大切だよ」とみんなに優しく教えました。駄菓子屋の前で、小さな誤解が無事に解けた午後でした。 |

2.Llama-3-ELYZA-JP-8B

Llama-3-ELYZA-JP-8Bの評価は以下のとおりです。

-

指定された文字数を上回る出力となりました。

-

登場人物が一部欠落していました。

-

内容はおおむね理解しているものの、証言者の話が抜けていました。

-

文章は「ですます調」で統一されていました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 208 | 3 | 理解している 〇 |

3 |

回答結果

| ローカルLLMからの回答 |

| まさるくんは放課後、駄菓子屋でチョコとラムネを買うために必要な150円が足りず、近くにいたあきなさんから100円を借りた。数日後、あきなさんは返してもらおうとしたが、まさるくんは忘れていて貸した覚えがないと否定した。周囲がざわつき険悪な雰囲気になったが、担任の先生が事情を聞いてくれて、まさるくんは謝って100円を返した。先生はお金の貸し借りにはメモや後で話すことが大切だと教え、小さな誤解が無事に解けた午後だった。 |

3.Llama-3.1-Swallow-8B-Instruct-v0.3

Llama-3.1-Swallow-8B-Instruct-v0.3の評価は以下のとおりです。

-

指定された文字数を上回る出力となりました。

-

登場人物が一部欠落していました。

-

内容は理解しているものの、証言者の話が抜けていました。

-

文章は「ですます調」で統一されていました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 219 | 3 | 理解している 〇 |

3 |

回答結果

| ローカルLLMからの回答 |

| まさるくんは、チョコとラムネを買うために100円足りないことに困っていました。そこであきなさんが100円を貸してくれますが、まさるくんはそのことをすっかり忘れてしまいます。あきなさんは「返して」と言いますが、まさるくんは「借りてないよ!」と言い張り、二人の間に誤解が生じます。そこで担任の先生が登場し、真実を明らかにします。先生は「お金の貸し借りにはメモを取り、後でしっかり話し合うことが大切」と教え、小さなトラブルも無事に解決しました。 |

4.Qwen2.5-7B-Instruct

Qwen2.5-7B-Instructの評価は以下のとおりです。

-

指定された文字数を上回る結果となりましたが、比較的近い文字数で出力されました。

-

登場人物が一部欠落していました。

-

内容は理解している様子が見られました。

-

文章には「ですます調」と「である調」が混在していました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 154 | 3 | 理解している 〇 |

3 |

回答結果

| ローカルLLMからの回答 |

| ある日、まさるくんはチョコとラムネを買おうとしたが50円しかなく、あきなさんが100円を貸した。数日後、あきなさんが返せと言ったところ、まさるくんが忘れていると思い違いになり険悪な雰囲気。担任の先生が証言し、誤解は解けました。先生は「貸借はしっかり記録するように」とみんなに教えた結果、無事に問題を解決した。 |

5.Tanuki-8B-dpo-v1.0

Tanuki-8B-dpo-v1.0の評価は以下のとおりです。

-

指定された文字数を上回る結果となりましたが、比較的近い文字数で出力されました。

-

登場人物が一部欠落していました。

-

内容はおおむね理解している様子が見られました。

-

日本語の表現にやや違和感がありました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 164 | 3 | 理解している 〇 |

4 |

回答結果

| ローカルLLMからの回答 |

| ある放課後、まさるくんは財布に50円しかなくチョコとラムネを買おうとしていましたが、あきなさんに100円を借りました。数日後、その事実を忘れていたまさるくんとあきなさんの間で貸し借りの争いが勃発しましたが、担任の先生が仲裁し、最終的に和解しました。この経験を通じて、お金の貸し借りにはメモや話し合いが重要であることを学びました。 |

6.RakutenAI-7B-Instruct

RakutenAI-7B-Instructの評価は以下のとおりです。

-

指定された文字数を上回る結果となりました。

-

登場人物はすべて網羅されていました。

-

内容は十分に理解している様子が見られました。

-

日本語としてわかりやすく、丁寧な文章で構成されていました。

この楽天製LLMが一番良いかと思いました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 180 | 4 | 理解している 〇 |

5 |

回答結果

|

|

| まさるくんは放課後、駄菓子屋でチョコとラムネを買うために100円足りず困っていました。あきなさんが100円を貸してくれたのですが、数日後にあきなさんが「返して」と言ったのに対し、まさるくんが「借りてないよ」と忘れていたため、二人は険悪な雰囲気になりました。担任の先生が通りかかり、事情を聞き、証言したこうたくんの言葉で、まさるくんは謝罪し100円を返しました。 |

7.Mistral-7B-Instruct-v0.3

Mistral-7B-Instruct-v0.3の評価は以下のとおりです。

-

指定された文字数を上回る結果となりました。

-

登場人物が一部欠落していました。

-

内容は理解している様子が見られました。

-

日本語表現にやや不自然な箇所がありました。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 225 | 4 | 理解している 〇 |

4 |

回答結果

| ローカルLLMからの回答 |

| 一日、まさるくんは駄菓子屋でチョコとラムネを買いたいが、財布に50円しかなかった。近くにいたあきなさんは100円を貸してくれた。 数日後、あきなさんが返すのを要求したら、まさるくんは借りていないと思っていたため驚かった。先生に確認すると、 こうたくんが見たように、あきなさんが100円を渡した事実が証明された。まさるくんは謝って返金した。 先生は教えており、お金の貸し借りはメモを取ったり、後で話し合うことを強調した。小さな誤解が無事に解けた午後だった。 |

8.plamo-13b

plamo-13bの評価は以下のとおりです。

-

指定された文字数を上回る結果となりました。

-

内容を理解しているかどうかは判断が難しい結果となりました。

日本語チューニングされたものがあれば試してみる価値はありかと思います。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 394 | 0 | 理解していない | 1 |

回答結果

| ローカルLLMからの回答 |

| 0は「Iとのと「2090「になったと「は「○○は、「や「」をごと、が、日本が「D「おたのは、でしょうかもで、「○○はこちらのおすすめてでも、くとしてのがの人 というときをとしてるがばのとのはさんが、の決めるのはで、その、そして、先日のトをので、ここはばさすばさどがんでごんが、のレベルがやきが困りが「今回向こういうのトサカイザコ「 1324880200000」お客」とに、「あろ「1、私も、と、「思い切り「日、お客様でいい、」、とお気、お客のを、、その、、、」。、」。)。でした。 -」でしたころ。というわけをや、何の「ね。な、私は、今ごろ、、が20001600003085, は、がもあーと、トメーイキチ・・お客様へ、「む、”、私を、本当た、なんか。、、に、、、100、1.」の、、、、の、 、で、も、、で、の、、、、も「、、、、と、、、、、が、、、も、、、、、、、、、、、、、、、、、 |

9.Stockmark-13b

Stockmark-13bの評価は以下のとおりです。

-

出力は指定された文字数以内でしたが、少なすぎる印象でした。

-

登場人物が欠落していました。

-

内容は理解している様子が見られました。

LLMモデルの癖は強めかなと思います。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 75 | 2 | やや理解している △ |

2 |

回答結果

| ローカルLLMからの回答 |

| まさるくんとあきなさんは仲直りした

まさるくんは100円を借りたことを忘れていた あきなさんはお金を貸したことを覚えていた まさるくんが悪い |

10.cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese

cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japaneseの評価は以下のとおりです。

-

出力は指定された文字数以内に収まっていました。

-

登場人物はすべて網羅されていました。

-

内容はしっかりと理解している様子が見られました。

-

文章は端的にまとめられており、非常に理解しやすい内容でした。

ただし、回答までに要する処理時間は今回の中で最も長くなりましたが、これはタカヒロの環境に起因するもので、

高性能なGPUを搭載したPC環境であれば、このモデルを採用することがよいかもしれません。

評価

| 文字数カウント | 登場人物網羅 全4人 |

内容理解度 | 評価(5段階) |

| 107 | 4 | 理解している 〇 |

5 |

回答結果

| ローカルLLMからの回答 |

| まさるくんは駄菓子屋で100円不足で困ったが、あきなさんに貸してもらうも数日後に返済を忘れた。証言者と担任の仲裁で解決し、「お金の貸し借りにはメモや話し合いが重要」と教わった。小さな誤解が無事に収まった午後だった。 |

さいごに

いかがでしょうか。

今回は、

についてまとめました。

上記評価からおすすめの日本語対応 軽量版ローカルLLMは

-

6.RakutenAI-7B-Instruct

-

10.cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese

となります。

ぜひ現場の取入れを検討してみてください。

コメントを残す